Transformer のアテンション マップを視覚化することは、超スマート マシンの内部動作を覗き込むようなものです。これは、モデルが情報をどのように処理するかを理解するのに役立ち、デバッグ、パフォーマンスの向上、新しい洞察の取得に非常に役立ちます。変圧器のサプライヤーとして、私はこの視覚化がいかに重要であるかを直接見てきました。それでは、これらのアテンション マップを視覚化する方法について詳しく見ていきましょう。

トランスフォーマーにおける注意を理解する

視覚化に入る前に、注意とは何かを知る必要があります。 Transformer におけるアテンションは、予測を行うときにモデルが入力シーケンスのさまざまな部分に焦点を当てることを可能にするメカニズムです。シーケンス内の各要素のスコアが計算され、これらのスコアによって、モデルが各要素にどの程度の「注意」を払う必要があるかが決まります。

長い記事を読むようなものだと考えてください。特定の文を理解しようとしているとき、関連する前の文を振り返ることがあります。 Transformer のアテンション メカニズムも同様のことを行いますが、はるかに大規模かつより正確に実行されます。

アテンション マップの視覚化が重要な理由

アテンション マップを視覚化することは、いくつかの理由から重要です。まず、モデルの決定を解釈するのに役立ちます。感情分析などに Transformer を使用している場合、モデルが予測を行うために入力テキスト内のどの単語に注目しているかを確認できます。これにより、モデルが論理的な決定を行っているかどうか、またはノイズの多いデータの影響を受けているかどうかを示すことができます。

次に、デバッグに最適です。モデルのパフォーマンスが低い場合、アテンション マップを視覚化すると、モデルが無視している、または過剰に焦点を当てている入力部分があるかどうかが明らかになります。その後、それに応じてモデルのアーキテクチャまたはトレーニング データを調整できます。

アテンション マップを視覚化するためのステップバイステップ ガイド

ステップ 1: データを準備する

トレーニングされた Transformer モデルといくつかの入力データが必要です。入力データは、モデルが処理できる形式である必要があります。たとえば、テキスト データを操作している場合は、トークン化する必要がある場合があります。

機械翻訳モデルがあるとします。原文とそれに対応する翻訳文のセットが必要になります。次のようなライブラリを使用できます変圧器Python でデータを簡単に準備できます。事前トレーニングされたモデルをロードし、入力テキストをトークン化するだけです。

トランスフォーマーからインポート AutoTokenizer、AutoModel tokenizer = AutoTokenizer.from_pretrained('your_model_name') model = AutoModel.from_pretrained('your_model_name') input_text = "ここにサンプル テキスト" inputs = tokenizer(input_text, return_tensors='pt')ステップ 2: アテンション値を抽出する

入力データの準備ができたら、モデルからアテンション値を抽出する必要があります。一般的なライブラリのほとんどの Transformer モデルは、これらの値にアクセスするメソッドを提供します。

出力 = モデル(**入力、output_attentions=True) 注意 = 出力.attentionsの注意変数には、トランスフォーマーの各レイヤーと各ヘッドのアテンション スコアが含まれるようになりました。

ステップ 3: 視覚化手法を選択する

アテンション マップを視覚化するにはいくつかの方法があります。一般的な方法の 1 つは、ヒートマップを使用することです。ヒートマップは、注目の強さを一目で示すことができるため、優れています。ヒートマップ内の各セルは、一対の入力要素間の注意スコアを表します。

次のようなライブラリを使用できますマットプロットライブラリまたはシーボーンPython でヒートマップを作成します。

import seaborn as sns import matplotlib.pyplot as plt # 最初のレイヤーと最初のヘッドのアテンションを視覚化 Layer = 0 head = 0attention_matrix = question[layer][0][head].detach().numpy() sns.heatmap(attention_matrix, cmap='viridis') plt.xlabel('Target Tokens') plt.ylabel('Source Tokens') plt.show()もう 1 つのオプションは、グラフまたはネットワーク視覚化を使用することです。これは、入力のさまざまな部分間の関係をより明確に確認したい場合に役立ちます。のようなツールネットワークxPython ではこれに役立ちます。

ステップ 4: 結果を解釈する

アテンション マップを視覚化したら、それを解釈します。ヒートマップまたはグラフでパターンを探します。モデルが常に多くの注意を払っている入力の特定の部分はありますか?無視されている部分はありますか?

テキスト関連のタスクに取り組んでいる場合は、実際の単語やトークンを確認することもできます。たとえば、質問応答システムでは、質問に答えるときに文章の関連部分に焦点を当てたモデルが表示されるはずです。

よくある課題とその克服方法

高次元性

アテンション マップは、特に大規模な Transformer モデルの場合、非常に高次元になる可能性があります。これにより、視覚化が困難になる可能性があります。これを克服するには、レイヤーまたはヘッド全体で注意スコアを集計することで次元を減らすことができます。興味のある入力の特定の部分に焦点を当てることもできます。

標準化の欠如

アテンション マップを視覚化する標準的な方法がないため、さまざまな視覚化を比較することが困難になる場合があります。これに対処する 1 つの方法は、一般的なカラー スケールと正規化技術を使用することです。これにより、さまざまなアテンション マップの解釈と比較が容易になります。

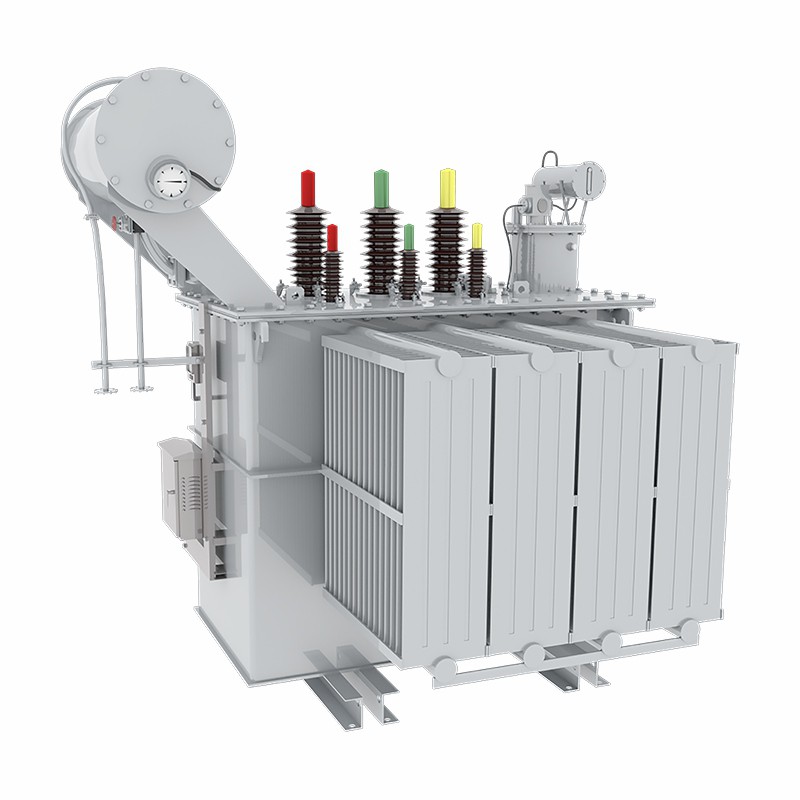

当社の変圧器製品

変圧器のサプライヤーとして、当社はさまざまな用途向けに高品質の変圧器を幅広く提供しています。お探しの場合は、低損失油埋込変圧器、系統用途向け、私たちはあなたをカバーします。これらの変圧器はエネルギー損失を最小限に抑えるように設計されており、送電網関連のプロジェクトに最適です。

私たちも持っています電源変圧器大量の電力を処理できるもの。これらは信頼性と効率性を確保するために最新のテクノロジーで構築されています。そして、必要な場合は、10000KVA 定格容積電力変圧器、それらもあります。

Transformer モデルで注意の視覚化を実験したいと考えている研究者であっても、業務に信頼できるトランスフォーマーを必要としている企業であっても、私たちはお手伝いをいたします。

調達に関するお問い合わせ

当社の Transformer 製品にご興味がある場合、またはアテンション マップの視覚化についてご質問がある場合は、ぜひご相談ください。お客様の具体的な要件についてご相談いただき、最適なソリューションを見つけてください。

参考文献

- Vaswani、A.、他。 (2017年)。 「必要なのは注意力だけです。」神経情報処理システムの進歩。

- デブリン、J.、他。 (2019年)。 「BERT: 言語理解のためのディープ双方向トランスフォーマーの事前トレーニング」計算言語学協会北米支部の 2019 年会議の議事録。